金磊 发自 第四范式大厦

量子位 | 公众号 QbitAI

国产大模型能大战,又有一员猛将入局。

就在刚刚,第四范式自研大模型“式说”(4Paradigm SageGPT)在上线2个月后,终于来了一波能力首秀。

而且纵观整场活动的发布,最直观的感受就是:不一样,着实不一样。

怎么说?

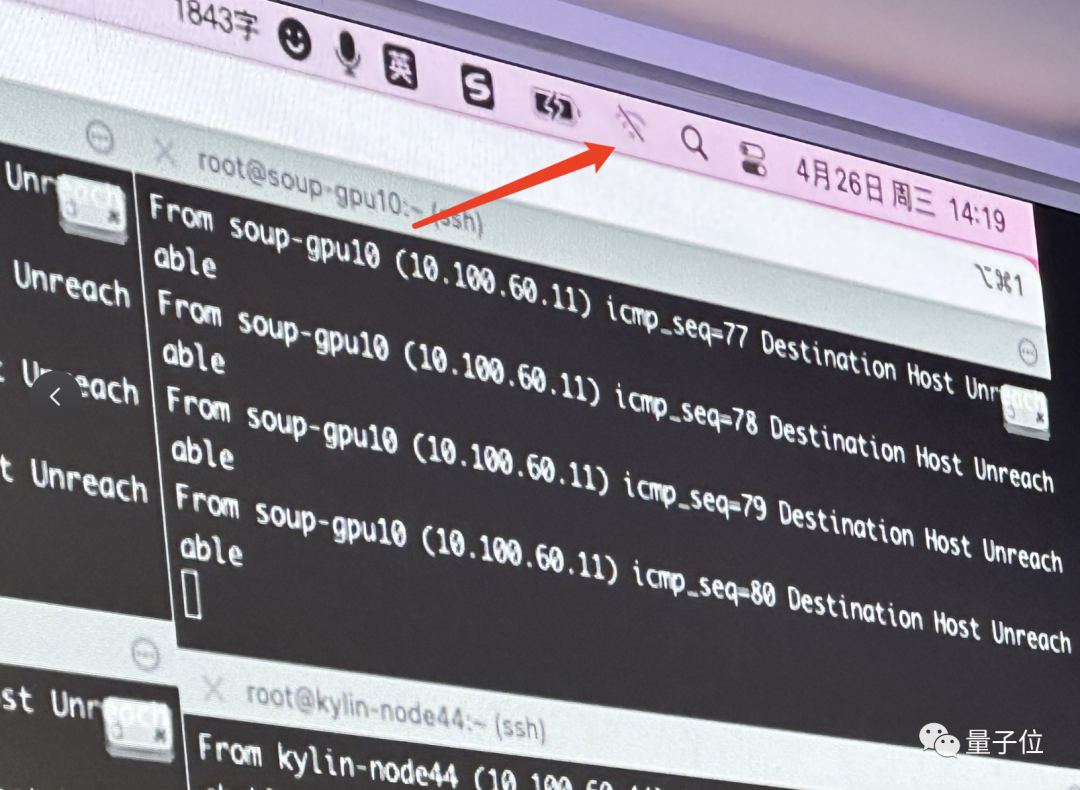

首先,他敢在现场演示的时候,拔!网!线!

效果是这样的,例如上传一张《狂飙》剧照之后,让“式说”描述一下照片,它的回答是:

这张照片中有一组穿着制服的男子站在一张桌子前。

而后追问剧照中有几个人,“式说”也立即给出了答案:9个。

再来看下以文生图的能力,先让它画一下“狮子头”:

不难看出,生成图片的效果是过关的;此时现场很多人立即开口说到:“红烧狮子头”呢?

第四范式不在怕的,马上在现场演示了起来:

接下来,是代码生成方面,第四范式在现场直接让“式说”秀了一下“Python猜随机数”:

面对敢于拔网线的live演示,现场观众也是惊叹与掌声不断。

但“不一样”的点还不只于此,而且上面展示的这些能力,也仅仅是“开胃菜”。

因为第四范式的GPT,并不是“你以为的你以为”,而是不同于其它厂商的一套玩法——

用AIGC的能力重构软件(AIGS),目的就是以此来提高企业软件的用户体验和开发效率。

例如让“式说”分析集装箱及小箱子尺寸,并设计装箱方案。

它就会先向用户咨询与之相关的细节的信息,然后便一步一步执行它的方案,还是会给出思考过程的那种。

对此,第四范式CEO戴文渊在现场给出了他的解释:

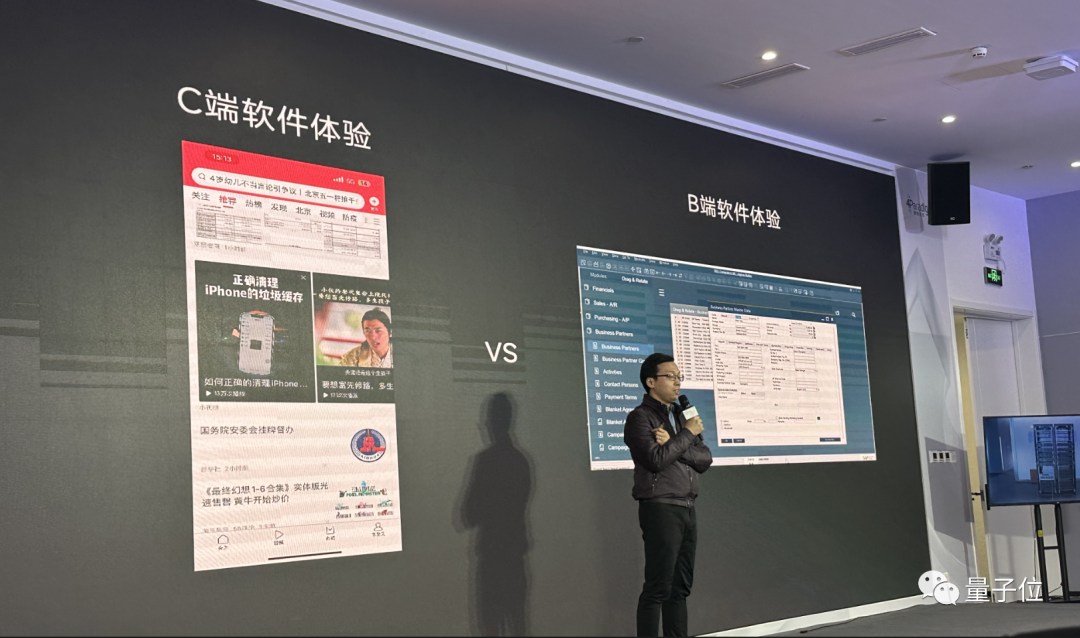

C端产品已经逼近用户体验的上限,而B端的企业级软件往往是个十分复杂的执行系统。

目前这些B端软件极为复杂的交互体验,以及复杂性带来的极低开发效率,恰恰为生成式AI留下足够大的重构和改造空间。

不是你以为的GPT

整体来看,“式说”之所以能够拥有上面展示的这般能力,是因为在它的背后拥有三大技术“利器”。

首先就是多模态大语言模型技术。

“式说”在最初2月发布之际所支持的能力是单一模态的,即文本对话能力。

而时隔仅1个月,第四范式便将语音、图像、表格、视频等多模态输入及输出能力融入了进来。

第二大技术“利器”,则是企业级Copilot。

值得一提的是,这个Copilot并非是微软、GitHub的那个Copilot。

而是第四范式通过自研大语言模型对专业领域的知识做理解,以便帮助用户实现某些功能。

例如在开发的过程中,在企业级Copilot的加持之下,所需的成本就只是把API对接进来即可。

什么概念?

这就好比ChatGPT Plugins一般,只需要安装特定领域第三方的插件,就能让ChatGPT在这个领域变得更加聪明、专业。

同样的,当企业使用“式说”时,Copilot就可以调出企业软件的有关功能,员工可以通过语音、图像、表格、视频等形式获取想要的答案。

例如在航空制造业,软件设计人员只需要上传一些图片,即可提出要求让“式说”在上百万的工装零件库中找出相似零件,并进行组装:

由此可见,“多模态大语言模型+Copilot”这套组合打法,可以让AIGC在产业实际落地过程中更加得心应手。

但若是仅仅如此,依旧还是远远不够的。

因为上述能力只能去应对某些单一的、碎片化的任务,而产业中的问题往往更加纷繁复杂。

就好比我们在用Photoshop去美化一张图片时,往往需要涉及裁剪、调滤镜、调亮度等等多个步骤。

不过往往人们想要的结果是一步到位,直接说一句“给我生成某个产品的海报”,所问即所得。

而这种情况放在企业生产过程中,不仅是要完整结果那么简单,还需要对生成的过程做到“不黑箱”,步步均可解释。

为此,第四范式便在上述两大“利器”之上,引入了第三个关键技术——企业级思维链(Chain of Thought,CoT)。

思维链这个概念最早是由谷歌提出,是一种特殊的上下文学习。

它不同于标准提示只是给出输入-输出对的示例,思维链提示还会额外增加一段推理的过程。

员工只需要交代一个任务,它不仅能够给你一个较为完美的答案,而且还会把期间所有流程是怎么思考的、如何执行的,一一都解释清楚。

值得一提的是,第四范式这种企业级思维链是针对特定领域学习的“套路”,是更具专业性、可信度的那种。

不过有一说一,第四范式今天的发布,并非是趁着这波大热潮一蹴而就的事情。

据第四范式介绍,早在BERT出来的时候,范式研究院就开始关注并投入在这个技术领域,GPT3出来以后就更加明确了这个方向。

与此同时,第四范式也坦诚地说“相比今年的投入,过去几年肯定还是有差距的”。

整体来看第四范式的技术路线,大致可以总结为三步:

-

式说1.0:拥有生成语言对话能力,主要场景是文库问答;相当于让GPT学习的企业知识后,可以自然地与员工交互,解答专业问题,并且是可溯源的。

-

式说2.0:加入文本、语音、图像、表格、视频等多模态输入及输出能力,并增加了企业级Copilot能力。

-

式说3.0:发力Copilot和思维链,提升使用传统B端企业软件的体验。

为何如此布局?

一言蔽之,AIGS,即用AIGC的能力重构软件。

毕竟能够用起来的技术好技术,虽然AIGC热潮很火爆、诸如GPT-4这般效果非常强悍的技术出现了,但它们之于产业,目前又带来了怎么技术价值?

这便是第四范式所思考的根本问题,而且戴文渊表示:

要做到AIGS,大模型未必需要是知识广博、十项全能冠军的通才。

更重要的在于模型具备Copilot和思维链CoT的能力。

在第四范式看来,传统B端软件先是出现过体验上的不足,例如企业内的报销系统、HR系统、OA系统等,可以说是“菜单接菜单,菜单何其多”。

而大语言模型的到来,使得这些复杂系统可以通过更好的交互方式去实现功能的调用,这是颠覆之一。

例如在AI改造后的企业软件,以预定会议室为例,不再需要在选日期、选时间段、选会议室了。

而是像跟秘书对话一般,直接来一句“帮我预定某某时间段的会议室”,即可。

在企业软件开发上,亦是如此。

因为传统B端企业软件往往都是高度定制化、基于菜单式的开发,每次一个功能升级,又要周而复始的经历原型图、设计、开发等,至少是月级别的开发时间。

但由于新的交互形式的出现,现在功能和逻辑只需在数据、API和内容层面下功夫即可,变成了天级别的开发效率,这又是颠覆之一。

正如第四范式所说:

我们看到大模型能够带来用户体验的提升,开发效率的提升,所以一定会形成软件行业的飞跃,就是谁率先能做出来的问题。

当软件产业被改造以后,整个行业的业务价值、商业模式都会得到飞跃。这是一个巨大的市场。

那么AIGS这条路,具体又该如何走?

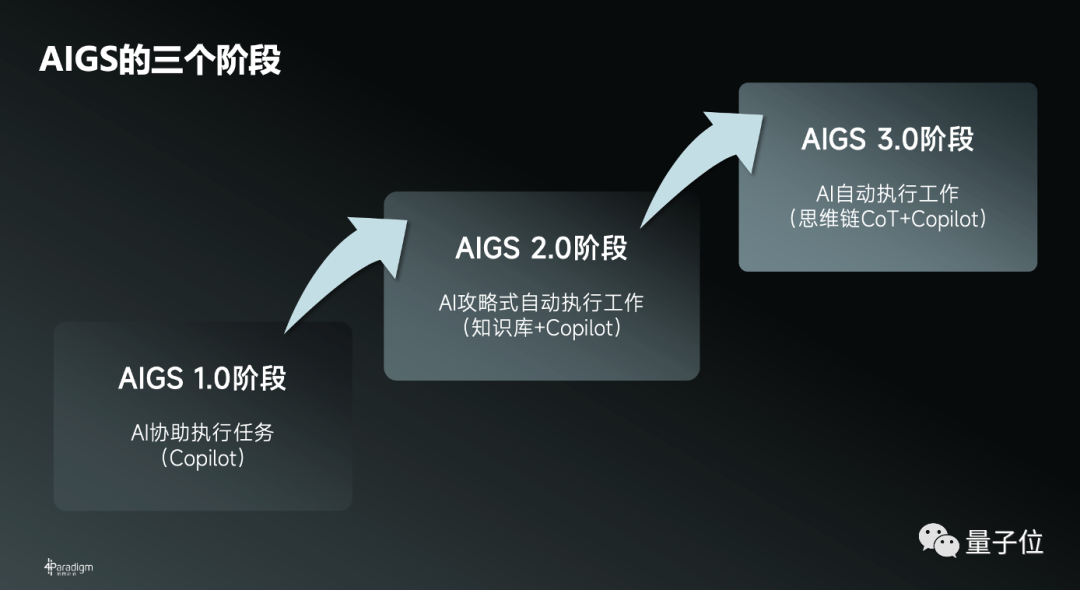

第四范式对这个问题也给出了自己的见解,主要分为三大阶段:

-

第一阶段:Copilot调动不同的信息、数据、应用,作为助手完成用户的指令。相当于在所有企业级软件系统里,配备一个指挥官。指挥官听用户的指挥,比如“把照片亮度调亮20%”。

-

第二阶段:Copilot+基于企业规则的“知识库”,AI能够参照规则做复杂工作,比如AI查询了“人像美化”知识库后,能执行把照片修好看的步骤。

-

第三阶段:Copilot+CoT。软件系统的使用行为最终会被大模型学会,形成AI针对这个领域的思维链,意味着“把照片处理得更好看”这种复杂指令,AI能自动地按照步骤完成。

但更深一层的,若是细看下第四范式的过往,就不难发现如此布局背后的本质——“做企业级”、“与软件公司打交道”似乎一直是刻在第四范式的一个基因。

那么这一次,第四范式是否能用AIGC重塑产业软件的新范式,是值得期待了。

— 完 —

点这里